simulate_p_trajectory <- function(seed, max_n = 300) {

set.seed(seed)

# Due campioni dalla STESSA distribuzione

full_sample1 <- rnorm(max_n, mean = 0, sd = 2)

full_sample2 <- rnorm(max_n, mean = 0, sd = 2)

# Calcola p-value per dimensioni campionarie crescenti

sample_sizes <- seq(10, max_n, by = 5)

p_values <- sapply(sample_sizes, function(n) {

t.test(full_sample1[1:n], full_sample2[1:n], var.equal = TRUE)$p.value

})

data.frame(n = sample_sizes, p = p_values, seed = factor(seed))

}

# Genera tre traiettorie diverse

trajectories <- do.call(rbind, lapply(c(42, 123, 456), simulate_p_trajectory))

ggplot(trajectories, aes(x = n, y = p, color = seed)) +

geom_line(linewidth = 0.8, alpha = 0.8) +

geom_hline(yintercept = 0.05, linetype = "dashed", color = "#8f2727", linewidth = 1) +

annotate("text", x = 280, y = 0.08, label = "α = 0.05", color = "#8f2727", size = 3.5) +

scale_y_continuous(limits = c(0, 1)) +

labs(

x = "Dimensione campionaria (per gruppo)",

y = "p-value",

color = "Simulazione"

) 3 La crisi della replicabilità

Prima di procedere, ti consiglio tre letture che offrono prospettive complementari:

- The Academic Culture of Fraud — Un’analisi della cultura accademica che ha permesso alla frode di prosperare.

- Why Most Published Research Findings Are False — L’articolo seminale di Ioannidis che ha anticipato la crisi.

- The staggering death toll of scientific lies — Le conseguenze umane della frode scientifica.

3.1 Una storia in tre atti

La crisi della replicabilità non è scoppiata all’improvviso. Si è sviluppata lentamente, ignorando o minimizzando segnali che si sono accumulati per anni, finché una serie di eventi ravvicinati ha reso impossibile distogliere lo sguardo. Riflettere su questa vicenda non è un esercizio di archeologia accademica, ma un modo per comprendere come siamo arrivati a questo punto e, soprattutto, come evitare di ritrovarci nella stessa situazione.

3.1.1 Atto primo: i profeti inascoltati (2005)

Nel 2005, John Ioannidis pubblicò un articolo dal titolo provocatorio: “Why Most Published Research Findings Are False” (Ioannidis, 2005). La tesi, semplice ma inquietante, era la seguente: in un sistema accademico caratterizzato da campioni di piccole dimensioni, flessibilità analitica, pressione a ottenere risultati “interessanti” e un forte bias di pubblicazione, la maggior parte dei risultati scientifici pubblicati ha un’alta probabilità di essere falsa.

L’articolo è diventato uno dei più citati nella storia della psicologia. Tuttavia, per anni è rimasto una voce isolata e inascoltata: tutti lo citavano, ma quasi nessuno ne traeva le dovute conseguenze. La psicologia, nel suo complesso, proseguì imperterrita con le sue pratiche consolidate. I laboratori producevano dati, le riviste pubblicavano articoli e le carriere avanzavano. In un sistema che sembrava funzionare, quale incentivo c’era a cambiare?

La risposta arrivò sei anni dopo, nel modo più improbabile.

3.1.2 Atto secondo: l’anno che cambiò tutto (2011)

Il 2011 fu l’annus horribilis per la psicologia sociale. Due eventi apparentemente scollegati tra loro, ma che in realtà si intrecciarono, portarono alla luce le fragilità della disciplina.

3.1.2.1 Daryl Bem e la precognizione

Daryl Bem, uno stimato psicologo della Cornell University, noto per i suoi contributi alla teoria dell’autopercezione, divenne protagonista di uno scandalo metodologico con la pubblicazione del suo articolo Feeling the Future nel Journal of Personality and Social Psychology, una delle riviste più prestigiose del settore. Nel lavoro, Bem presentava nove esperimenti che, utilizzando metodologie standard, sembravano offrire prove “statisticamente significative” a favore della precognizione, ovvero la capacità di percepire eventi futuri prima che accadano.

L’esperimento più provocatorio era una variante temporale del classico paradigma di priming. Nella sua forma tradizionale, il priming mostra come uno stimolo precedente (per esempio, la parola “felice”) influenzi la successiva valutazione di un’immagine. Bem ne invertì la sequenza: i partecipanti valutavano prima un’immagine, e solo dopo veniva loro presentato uno stimolo di priming. Sorprendentemente, l’effetto di congruenza persisteva: i soggetti erano più rapidi nel giudicare come piacevoli quelle immagini che, in seguito, sarebbero state associate a parole positive.

I risultati erano formalmente inattaccabili: valori-\(p\) inferiori a 0.05, metodi canonici, un processo di peer review superato, la pubblicazione su una rivista di prestigio. Eppure, la comunità si trovò di fronte a un dilemma epistemologico imbarazzante: accettare la possibilità della precognizione o ammettere che le pratiche di ricerca standard, che includono esperimenti con piccoli campioni e una grande flessibilità analitica, possono generare “evidenze” convincenti anche per i fenomeni paranormali, contraddicendo così tutte le nostre conoscenze scientifiche consolidate.

Il vero scandalo, quindi, non era che Bem credesse ai fenomeni paranormali, ma che l’intero sistema metodologico della psicologia fosse strutturalmente fragile. Se quelle stesse procedure potevano validare la precognizione, quale certezza rimaneva per tutti gli altri fenomeni pubblicati con gli stessi criteri? L’esperimento di Bem non metteva in discussione un singolo risultato, ma l’affidabilità della produzione scientifica dell’intera disciplina.

3.1.2.2 Diederik Stapel e la fabbrica dei dati

Pochi mesi dopo, la comunità psicologica olandese fu scossa da uno scandalo senza precedenti. Diederik Stapel, professore presso l’Università di Tilburg e figura di spicco della psicologia sociale europea, fu accusato di aver falsificato i dati di decine di studi pubblicati nell’arco di oltre un decennio.

I suoi studi erano affascinanti e controintuitivi: l’ambiente disordinato aumenta il razzismo, mangiare carne rende più antisociali e la discriminazione danneggia le prestazioni cognitive delle minoranze. Studi eleganti, risultati chiari e pubblicazioni su riviste prestigiose. C’era solo un problema: i dati non esistevano. Stapel li aveva inventati di sana pianta, spesso senza nemmeno reclutare i partecipanti che dichiarava di avere testato.

La commissione d’inchiesta scoprì che la frode era iniziata fin dai tempi del dottorato e si era protratta per quasi vent’anni. Cinquantotto articoli furono ritirati. Ma la domanda più inquietante era un’altra: come aveva potuto andare avanti così a lungo? Come era possibile che nessuno, collaboratori, revisori o editori, si fosse accorto di nulla?

La risposta era semplice e terribile: nessuno controllava. Il sistema si basava sulla fiducia e la fiducia era stata tradita.

3.1.3 Atto terzo: il verdetto (2015)

Dopo gli shock del 2011, la comunità psicologica reagì in modi diversi. Alcuni minimizzarono il problema, parlando di “casi isolati”, altri difesero le pratiche esistenti, mentre un gruppo minoritario ma determinato colse l’occasione per avviare una riflessione metodologica radicale.

Brian Nosek, psicologo dell’Università della Virginia, guidò quest’ultimo fronte. Nel 2012 fondò l’Open Science Collaboration (OSC), un progetto senza precedenti che prevedeva la replicazione sistematica di 100 studi pubblicati sulle tre riviste di psicologia più prestigiose. L’obiettivo non era quello di selezionare lavori deboli, ma di campionare la produzione scientifica ordinaria della disciplina, considerata la più solida (Nosek et al., 2012).

Il progetto coinvolse oltre 270 ricercatori in tutto il mondo. La metodologia adottata fu rigorosa: gli autori originali furono consultati per garantire che le repliche fossero fedeli; le dimensioni campionarie furono aumentate per assicurare una potenza statistica adeguata e tutti i protocolli furono preregistrati per evitare aggiustamenti post hoc.

I risultati, pubblicati su Science nel 2015, furono un terremoto epistemologico: solo il 36% degli studi replicati produsse risultati statisticamente significativi. In psicologia sociale la percentuale crollava addirittura al 25%. Anche laddove gli effetti venivano replicati, le loro dimensioni medie risultavano dimezzate rispetto agli originali. Se gli effetti originari fossero stati reali, il tasso di replicabilità atteso (cioè la percentuale di studi che si sarebbero replicati) sarebbe stato dell’89%. Il divario tra aspettativa e realtà tra aspettativa teorica e realtà empirica costituiva un atto d’accusa devastante contro decenni di pratiche di ricerca consolidate (Collaboration, 2015).

3.2 Le storie dietro i numeri

Le statistiche aggregate raccontano solo una parte della storia. Per comprendere le radici profonde della crisi, è necessario passare dalle meta-analisi ai casi individuali, alle storie concrete dei ricercatori, alle pressioni istituzionali e agli incentivi distorti. Qui esaminiamo due esempi paradigmatici.

3.2.1 Il crollo dell’ego depletion

Per oltre un decennio, la teoria dell’“esaurimento dell’ego” è stata un pilastro della psicologia sociale. La metafora, introdotta da Roy Baumeister negli anni Novanta, era potente e intuitiva: l’autocontrollo funzionerebbe come un muscolo, che dopo uno sforzo si affatica, compromettendo la nostra capacità di resistere a tentazioni successive.

Centinaia di studi sembravano confermare questa teoria e le meta-analisi più autorevoli riportavano un effetto medio robusto. Il concetto varcò i confini accademici, diventando un luogo comune in manuali, TED Talk e saggi divulgativi.

Poi, con l’avvento della crisi della replicabilità, il castello ha cominciato a scricchiolare. I progetti “Many Labs”, progettati per garantire la massima potenza statistica e la massima trasparenza metodologica, fallirono sistematicamente nel replicare l’effetto, ottenendo risultati prossimi allo zero.

Come ha potuto un fenomeno così “solido” dissolversi? La spiegazione risiede in una combinazione sistematica di distorsioni: gli studi originali utilizzavano spesso campioni di piccole dimensioni e un’elevata flessibilità analitica, esplorando i dati finché non emergeva un risultato significativo. A ciò si aggiungeva un potente bias di pubblicazione che selezionava per le riviste solo gli esperimenti riusciti. Le meta-analisi, aggregando una letteratura già contaminata, non fecero altro che cristallizzare e amplificare un’illusione statistica. L’ego depletion non era forse un fenomeno inesistente, ma la sua reale entità era stata ingigantita ben oltre l’evidenza empirica, rivelando le crepe di un sistema scientifico che per anni aveva premiato il risultato sorprendente più della rigorosa verificabilità.

3.2.2 Il food lab della Cornell University: quando l’incentivo distorce il metodo

Brian Wansink ha diretto il Food and Brand Lab della Cornell University, un centro di ricerca all’avanguardia nello studio dei fattori ambientali che influenzano il comportamento alimentare. Le sue scoperte sono diventate paradigmi diffusi: un piatto più grande incoraggia a mangiare di più, le ciotole a riempimento automatico aggirano il senso di sazietà e attribuire un nome “esotico” a un piatto ne esalta il sapore percepito.

Nel 2017, tuttavia, un gruppo di ricercatori indipendenti passò al setaccio i suoi dataset pubblicati, scoprendo un quadro scioccante: più di 150 anomalie statistiche in un numero ristretto di articoli. Sono emersi numeri incongruenti, errori metodologici ricorrenti e pattern di dati atipici, indizi di una possibile manipolazione sistematica dei risultati. La Cornell University ha avviato un’indagine interna che ha portato all’accertamento di “cattiva condotta scientifica” da parte di Wansink, con il ritiro di diciotto suoi articoli e le sue dimissioni nel 2018.

Questa vicenda svela una verità fondamentale: il confine tra “flessibilità analitica” e frode scientifica è spesso sfumato e permeabile. A differenza di Diederik Stapel, che fabbricava dati inesistenti, Wansink operava in una zona grigia metodologica, testando ipotesi multiple a posteriori, eliminando selettivamente i dati anomali e affinando i criteri analitici fino a ottenere un risultato pubblicabile. Un sistema accademico ossessionato dalle pubblicazioni e dalla visibilità mediatica lo aveva acclamato per anni, prima che l’intera impalcatura crollasse sotto il peso della trasparenza e del rigore metodologico.

3.3 Perché è successo

Nel manuale abbiamo già esaminato le cause strutturali: la pressione del “publish or perish”, il bias di pubblicazione, le pratiche di ricerca discutibili e i limiti intrinseci del test di significatività statistica. Qui, invece, esamineremo una riflessione più personale che, partendo dal livello istituzionale, scende fino all’esperienza del singolo ricercatore.

La crisi di replicabilità non è il risultato di “cattivi scienziati”. La stragrande maggioranza dei ricercatori coinvolti in studi poi non replicabili erano persone in buona fede che cercavano di fare buona scienza all’interno di un sistema dagli incentivi distorti. Il problema non era, o non era principalmente, una questione di etica individuale. Era un problema sistemico.

Immagina di essere un ricercatore precario. Il tuo contratto scade tra due anni. Per ottenere una posizione stabile, devi pubblicare su riviste prestigiose. Per riuscirci, sono necessari risultati statisticamente “significativi”. Come sai, i risultati nulli hanno scarse possibilità. Hai un dataset che, analizzato in modo standard, produce un valore-\(p\) = 0.06, appena sopra la fatidica soglia di “significatività statistica”. Sai anche che, con qualche scelta analitica giustificabile, ovvero escludendo un outlier “sospetto”, controllando per una covariata aggiuntiva o cambiando lievemente il modello, quel valore-\(p\) potrebbe scendere a 0.04. Non stai falsificando i dati. Stiamo parlando di scelte metodologiche plausibili. Scelte che, però, convergono sistematicamente verso l’unico esito che il sistema premia: la significatività statistica.

Questa è l’essenza della “zona grigia” delle QRPs. Non si tratta di frode dichiarata, ma neanche di scienza rigorosa e trasparente. Quando centinaia di ricercatori, sotto le stesse pressioni, adottano le stesse flessibilità, l’effetto aggregato è una letteratura scientifica satura di falsi positivi e di effetti la cui entità viene sistematicamente sovrastimata.

3.3.1 Il paradosso di Meehl: quando tutto è “significativo”, nulla lo è

Già negli anni ’70, lo psicologo Paul Meehl aveva individuato con lucidità le profonde contraddizioni del paradigma dominante. In un esperimento concettuale illuminante, analizzò un dataset enorme, relativo a oltre 57000 studenti delle scuole superiori del Minnesota, incrociando una moltitudine di variabili (religione, hobby, ordine di nascita, aspirazioni future, ecc.). Considerò 990 coppie di variabili. Il risultato fu sorprendente: il 92% delle correlazioni risultò statisticamente significativo (Meehl, 2012).

L’intuizione di Meehl, però, andava ben oltre l’aneddoto. Il suo vero punto era metodologico: con campioni molto grandi e un numero elevato di confronti, qualcosa di “significativo” si trova quasi sempre per puro caso. La significatività statistica, svincolata da una forte teoria predittiva e da un contesto interpretativo, diventa una metrica vuota. La significatività statistica, dunque, non garantisce la rilevanza sostanziale o la robustezza di un risultato scientifico.

Tuttavia, l’intero ecosistema della ricerca, costituito da riviste, finanziatori e università, aveva ormai ancorato la propria autorevolezza a quella stessa metrica. Il paradosso denunciato da Meehl era tragico e sistemico: si stava abusando di uno strumento che, nell’uso comune, funzionava da macchina perfetta per produrre rumore statistico e scoperte spurie. Il fallimento collettivo nell’ascoltare questo monito avrebbe, qualche decennio dopo, costretto la psicologia a pagare un prezzo altissimo in termini di credibilità.

3.4 Vedere la crisi in azione

Le discussioni teoriche sono importanti, ma niente può sostituire l’esperienza diretta. Ora, con una simulazione, vediamo come le pratiche problematiche possano generare falsi positivi.

3.4.1 Il valore-\(p\) ballerino

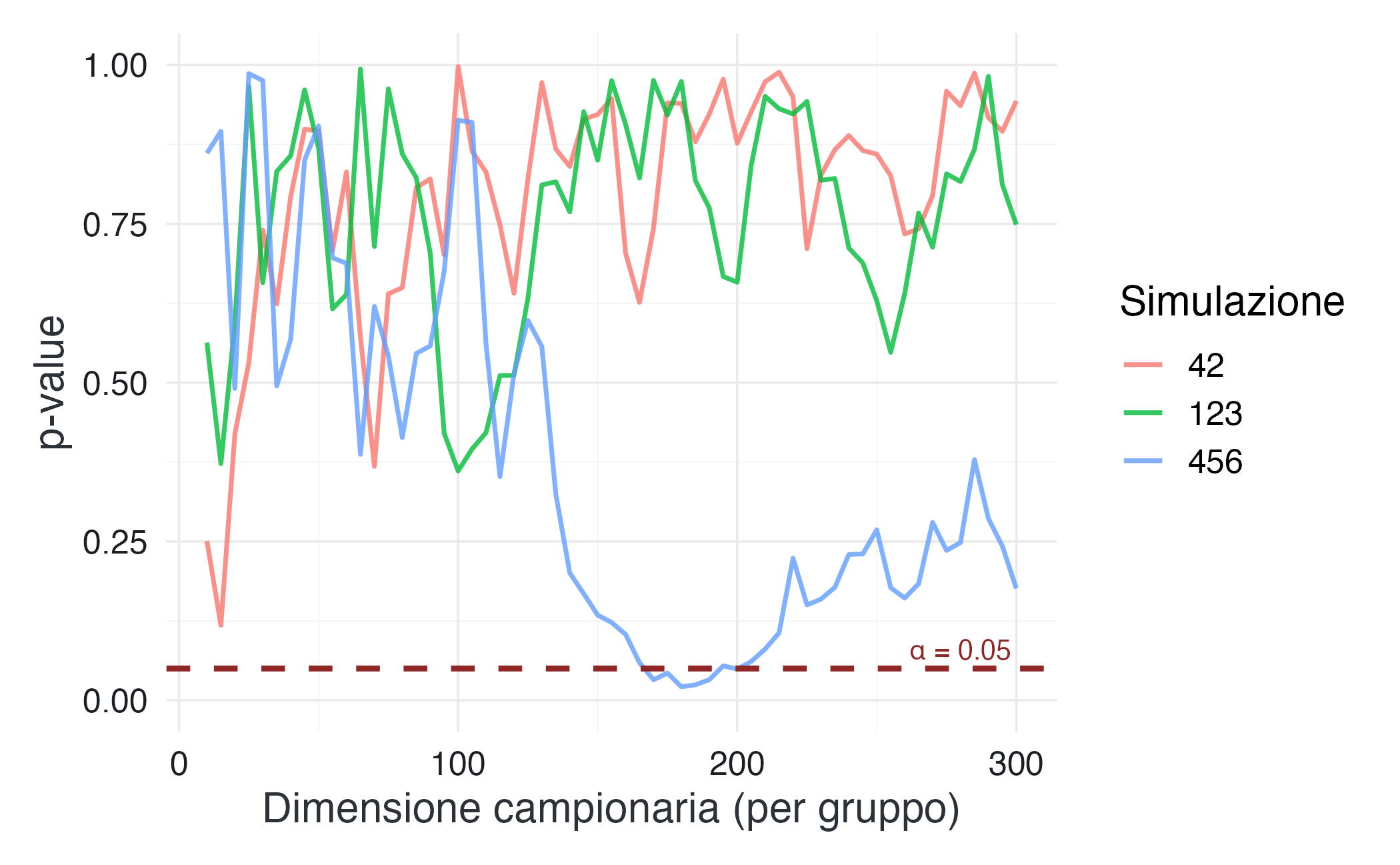

Immagina di confrontare due gruppi estratti dalla stessa popolazione (quindi, per definizione, non ci sono differenze reali). Cosa succede al valore-\(p\) mentre aumenti progressivamente la dimensione del campione?

Osserva la Figura 3.1: il valore-\(p\) non converge ordinatamente verso 1, come ci si aspetterebbe in assenza di un effetto reale. Al contrario, fluttua in modo erratico. In alcune esecuzioni della simulazione, attraversa ripetutamente la soglia di 0.05, talvolta per pochi dati, altre volte più a lungo.

Ora immagina un ricercatore che adotta l’optional stopping: raccoglie i dati in modo sequenziale, calcola ripetutamente il valore-\(p\) e decide di interrompere la raccolta proprio nel momento in cui il risultato diventa “statisticamente significativo”. Con questa strategia, prima o poi il successo è garantito, anche quando si parte da un’ipotesi completamente falsa. Il valore-\(p\) non diventa mai una misura affidabile dell’evidenza, ma piuttosto il bersaglio mobile di una caccia in cui il momento dell’arresto determina l’esito.

3.4.2 Cosa ci dice l’approccio bayesiano

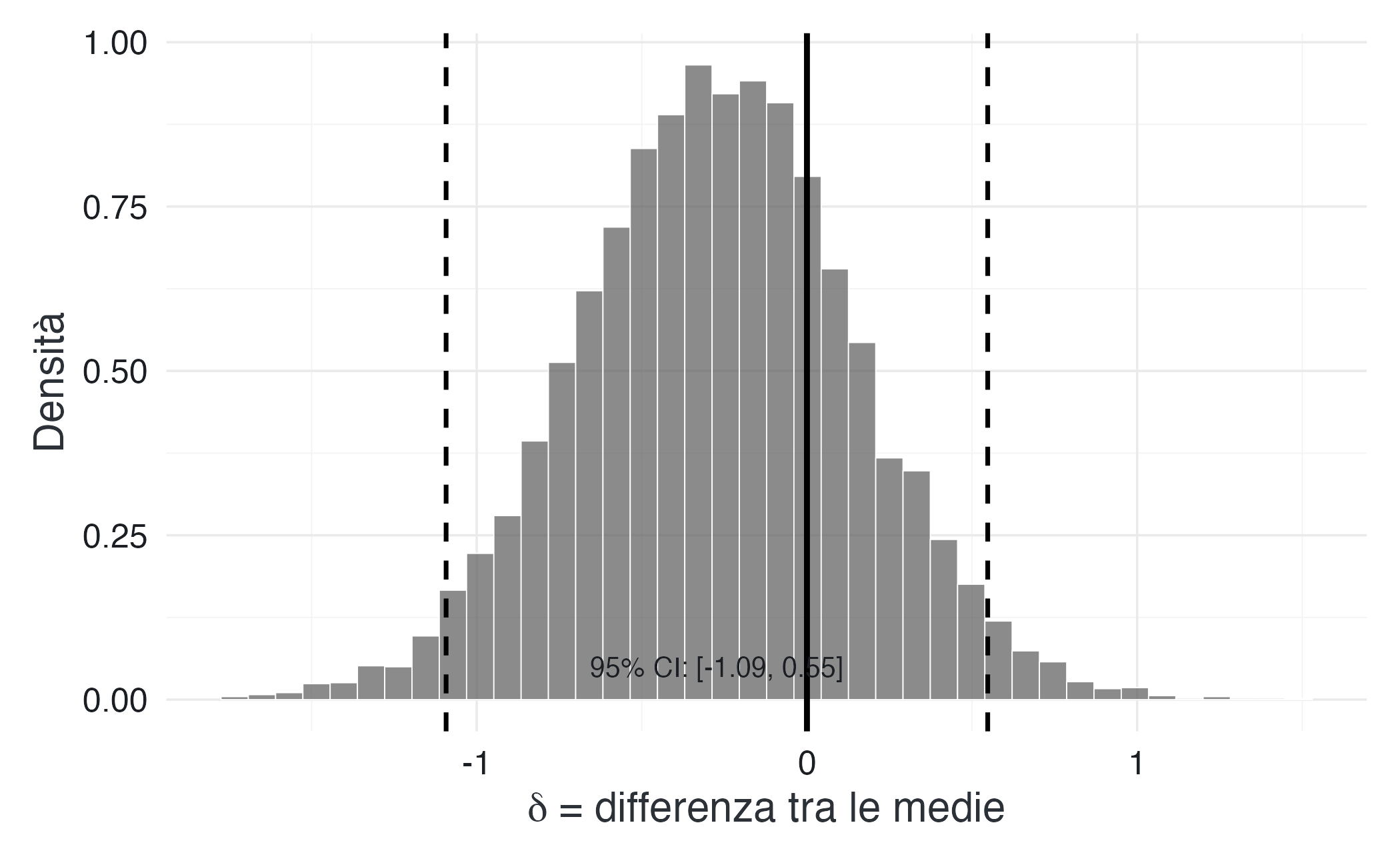

Analizziamo gli stessi dati con un modello bayesiano. La domanda è: qual è la distribuzione plausibile della differenza tra le medie dei due gruppi?

set.seed(42)

y1 <- rnorm(50, mean = 0, sd = 2)

y2 <- rnorm(50, mean = 0, sd = 2)

stan_data <- list(N1 = length(y1), N2 = length(y2), y1 = y1, y2 = y2)

stan_code <- "

data {

int<lower=0> N1;

int<lower=0> N2;

vector[N1] y1;

vector[N2] y2;

}

parameters {

real mu1;

real mu2;

real<lower=0> sigma;

}

transformed parameters {

real delta = mu1 - mu2;

}

model {

// Prior debolmente informativi

mu1 ~ normal(0, 5);

mu2 ~ normal(0, 5);

sigma ~ exponential(0.5);

// Verosimiglianza

y1 ~ normal(mu1, sigma);

y2 ~ normal(mu2, sigma);

}

"

mod <- cmdstanr::cmdstan_model(write_stan_file(stan_code))

fit <- mod$sample(

data = stan_data,

seed = 123,

chains = 4,

parallel_chains = 4,

iter_sampling = 2000,

iter_warmup = 1000,

show_messages = FALSE,

refresh = 0

)delta_draws <- fit$draws(variables = "delta", format = "df")$delta

ci_95 <- quantile(delta_draws, probs = c(0.025, 0.975))

ggplot(data.frame(delta = delta_draws), aes(x = delta)) +

geom_histogram(aes(y = after_stat(density)), bins = 40, alpha = 0.7, color = "white") +

geom_vline(xintercept = 0, linetype = "solid", linewidth = 1) +

geom_vline(xintercept = ci_95, linetype = "dashed", linewidth = 0.8) +

annotate("text", x = mean(ci_95), y = 0.05,

label = sprintf("95%% CI: [%.2f, %.2f]", ci_95[1], ci_95[2]),

size = 3.5) +

scale_color_qualitative() +

labs(

x = expression(delta~"= differenza tra le medie"),

y = "Densità"

) L’intervallo di credibilità al 95% per δ va da -1.09 a 0.55. Poiché tale intervallo comprende lo zero, possiamo affermare che, alla luce dei dati e delle assunzioni a priori, non c’è evidenza di una differenza rilevante tra i due gruppi.

Questo risultato è coerente con il modo in cui i dati sono stati generati (stessa distribuzione di origine). Tuttavia, osserva come cambia la comunicazione statistica rispetto al paradigma tradizionale:

- Frequentista: “Il valore-\(p\) è 0.03 → rifiuto l’ipotesi nulla” (decisione binaria, sensibile al campionamento e alle soglie arbitrarie).

- Bayesiano: “La distribuzione a posteriori di δ è concentrata attorno a zero, con ampia incertezza” (descrizione continua dell’evidenza e della sua incertezza).

L’inferenza bayesiana non rende la ricerca immune da errori o interpretazioni scorrette. Ciò che cambia è il linguaggio dell’incertezza: invece di costringerci a fornire una risposta sì/no basata su un valore di soglia, ci permette di esprimere il nostro livello di incertezza, la direzione e l’intensità di quest’ultima. Un modello non prende decisioni al posto nostro, ma ci offre una rappresentazione più fedele della conoscenza che i dati ci permettono di ottenere e dei suoi limiti.

3.5 Oltre la crisi: verso una nuova cultura scientifica

La crisi di replicabilità ha avuto almeno un merito innegabile: ha costretto la psicologia a un doloroso, ma necessario, esame di coscienza collettivo. Da questo confronto è nata una rivoluzione della credibilità (credibility revolution) che sta lentamente, ma inesorabilmente, riscrivendo le regole della disciplina.

3.5.1 I progressi tangibili

Rispetto al panorama di un decennio fa, il cambiamento è già evidente:

- La condivisione aperta di dati e codice, prerequisito per la riproducibilità analitica, non è più un’opzione ma un requisito. Essa abilita il controllo indipendente e rende la conoscenza veramente cumulativa.

- I progetti di ricerca multi-lab (Many Labs, Many Babies, Psychological Science Accelerator) dimostrano che la collaborazione su larga scala può produrre evidenze più solide e generalizzabili, superando i limiti dei singoli laboratori.

- La preregistrazione sta diventando una pratica consolidata. Sebbene non sia una soluzione miracolosa, riduce drasticamente il margine per il p-hacking e per costruire narrazioni ad hoc a partire dai risultati ottenuti.

- I Registered Reports hanno ribaltato la logica della pubblicazione. Il merito scientifico viene valutato nella fase di progettazione, prima ancora che i dati vengano raccolti. Questo sgancia l’accettazione dal risultato finale, neutralizzando alla radice il bias di pubblicazione.

3.5.2 Le sfide aperte

Tuttavia, la trasformazione è ancora incompleta. I sistemi di incentivi accademici evolvono lentamente, la pressione a pubblicare rimane intatta e l’adozione di queste pratiche virtuose non è ancora uniforme.

La sfida più profonda, però, è concettuale: non basta adottare nuove procedure se non cambia il framework con cui interpretiamo l’evidenza. L’approccio bayesiano, che costituirà la bussola delle prossime sezioni, offre un linguaggio logicamente più coerente per quantificare l’incertezza e aggiornare le nostre credenze alla luce dei dati. Tuttavia, richiede un investimento in formazione, strumenti computazionali e nuove abitudini cognitive.

Questo investimento è necessario. Il criterio ultimo, infatti, non è l’ortodossia di un metodo in astratto, ma la sua utilità concreta: ci aiuta a capire la mente umana? Permette di costruire una conoscenza che si accumula invece di disperdersi? Genera risultati affidabili e verificabili?

La crisi ha messo in luce che, per lungo tempo, le risposte a queste domande sono state deludenti. L’obiettivo di questo companion è fornirti gli strumenti per immaginare e costruire un futuro diverso, un futuro in cui queste risposte possano essere, in modo replicabile e motivato, affermative.

3.6 Per approfondire

- Pennington (2023) — Testo di riferimento adottato per questo capitolo.

- Collaboration (2015) — Risultati completi del Reproducibility Project.

- Simmons et al. (2011) — Articolo seminale sulle pratiche di ricerca flessibili.

- Retraction Watch — Database aggiornato delle ritrattazioni scientifiche.

- Data Colada — Blog di Uri Simonsohn e collaboratori sulla metodologia della ricerca.

sessionInfo()

#> R version 4.5.2 (2025-10-31)

#> Platform: aarch64-apple-darwin20

#> Running under: macOS Tahoe 26.2

#>

#> Matrix products: default

#> BLAS: /System/Library/Frameworks/Accelerate.framework/Versions/A/Frameworks/vecLib.framework/Versions/A/libBLAS.dylib

#> LAPACK: /Library/Frameworks/R.framework/Versions/4.5-arm64/Resources/lib/libRlapack.dylib; LAPACK version 3.12.1

#>

#> locale:

#> [1] C.UTF-8/UTF-8/C.UTF-8/C/C.UTF-8/C.UTF-8

#>

#> time zone: Europe/Rome

#> tzcode source: internal

#>

#> attached base packages:

#> [1] stats graphics grDevices utils datasets methods base

#>

#> other attached packages:

#> [1] cmdstanr_0.8.0 ragg_1.5.0 tinytable_0.15.2

#> [4] withr_3.0.2 systemfonts_1.3.1 patchwork_1.3.2

#> [7] ggdist_3.3.3 tidybayes_3.0.7 bayesplot_1.15.0

#> [10] ggplot2_4.0.1 reliabilitydiag_0.2.1 priorsense_1.2.0

#> [13] posterior_1.6.1 loo_2.9.0 rstan_2.32.7

#> [16] StanHeaders_2.32.10 brms_2.23.0 Rcpp_1.1.0

#> [19] sessioninfo_1.2.3 conflicted_1.2.0 janitor_2.2.1

#> [22] matrixStats_1.5.0 modelr_0.1.11 tibble_3.3.0

#> [25] dplyr_1.1.4 tidyr_1.3.2 rio_1.2.4

#> [28] here_1.0.2

#>

#> loaded via a namespace (and not attached):

#> [1] gridExtra_2.3 inline_0.3.21 sandwich_3.1-1

#> [4] rlang_1.1.7 magrittr_2.0.4 multcomp_1.4-29

#> [7] snakecase_0.11.1 otel_0.2.0 compiler_4.5.2

#> [10] vctrs_0.6.5 stringr_1.6.0 pkgconfig_2.0.3

#> [13] arrayhelpers_1.1-0 fastmap_1.2.0 backports_1.5.0

#> [16] labeling_0.4.3 rmarkdown_2.30 ps_1.9.1

#> [19] purrr_1.2.1 xfun_0.55 cachem_1.1.0

#> [22] jsonlite_2.0.0 broom_1.0.11 parallel_4.5.2

#> [25] R6_2.6.1 stringi_1.8.7 RColorBrewer_1.1-3

#> [28] lubridate_1.9.4 estimability_1.5.1 knitr_1.51

#> [31] zoo_1.8-15 pacman_0.5.1 Matrix_1.7-4

#> [34] splines_4.5.2 timechange_0.3.0 tidyselect_1.2.1

#> [37] abind_1.4-8 yaml_2.3.12 codetools_0.2-20

#> [40] processx_3.8.6 curl_7.0.0 pkgbuild_1.4.8

#> [43] lattice_0.22-7 bridgesampling_1.2-1 S7_0.2.1

#> [46] coda_0.19-4.1 evaluate_1.0.5 survival_3.8-3

#> [49] RcppParallel_5.1.11-1 pillar_1.11.1 tensorA_0.36.2.1

#> [52] checkmate_2.3.3 stats4_4.5.2 distributional_0.5.0

#> [55] generics_0.1.4 rprojroot_2.1.1 rstantools_2.5.0

#> [58] scales_1.4.0 xtable_1.8-4 glue_1.8.0

#> [61] emmeans_2.0.1 tools_4.5.2 data.table_1.18.0

#> [64] mvtnorm_1.3-3 grid_4.5.2 QuickJSR_1.8.1

#> [67] colorspace_2.1-2 nlme_3.1-168 cli_3.6.5

#> [70] textshaping_1.0.4 svUnit_1.0.8 Brobdingnag_1.2-9

#> [73] V8_8.0.1 gtable_0.3.6 digest_0.6.39

#> [76] TH.data_1.1-5 htmlwidgets_1.6.4 farver_2.1.2

#> [79] memoise_2.0.1 htmltools_0.5.9 lifecycle_1.0.5

#> [82] MASS_7.3-65